智能客服的情绪安抚策略会引发法律纠纷吗?

智能客服的情绪安抚策略会引发法律纠纷吗?

随着科技的不断发展,智能客服逐渐成为了许多企业和组织的服务方式之一。其中,智能客服的情绪安抚策略也逐渐受到了广泛的关注和讨论。然而,这些策略在实践过程中也可能会引发一些法律问题。本文将就这一问题进行探讨。

一、智能客服情绪安抚策略概述

智能客服情绪安抚策略,即利用智能化的聊天系统或虚拟机器人进行在线对话的过程中,对于用户因不同问题所展现的消极情绪(如焦虑、生气、无助等)进行有效的应对与安慰,以此缓解用户的不满情绪,提升用户的服务体验。

二、智能客服情绪安抚策略的优点

智能客服情绪安抚策略的优点在于其高效性、及时性和个性化。智能客服系统能够快速响应和安慰用户的情绪问题,同时也能够根据用户的情况和反馈调整安抚方式,增强服务的互动性和个性体验。对于许多公司和机构而言,这种方式既可以降低人力资源的消耗,也可以在一定程度上改善服务质量。

三、可能产生的法律风险

尽管智能客服情绪安抚策略有着明显的优点,但在实施过程中也可能会引发一些法律风险。主要的风险包括:

1. 表达误导问题:在运用智能语言处理技术进行情绪安抚时,可能会因为技术的不完善或理解偏差导致对用户的问题或情绪产生误解,从而给出错误的回应或建议。如果这种误导导致用户产生进一步的损失或伤害,就可能引发法律纠纷。

2. 隐私保护问题:在收集、处理和存储用户数据时,必须严格遵守相关的隐私保护法律法规。如果智能客服系统在未经用户同意的情况下,将用户的个人信息泄露给第三方或用于其他用途,就可能面临法律责任。

3. 法律责任不明确:在目前的法律法规中,对于智能客服的法律责任尚无明确规定。因此,一旦发生争议或纠纷,如何界定智能客服的法律责任就成了一个问题。这可能导致在处理纠纷时出现法律空白或模糊地带。

四、应对策略

为了减少智能客服情绪安抚策略引发的法律风险,可以采取以下措施:

1. 完善技术手段:不断优化和改进智能语言处理技术,提高对用户情绪和问题的理解和应对能力。同时,也要确保系统的稳定性和安全性。

2. 遵守法律法规:在收集、处理和存储用户数据时,必须严格遵守相关的隐私保护法律法规。同时,也要确保智能客服系统的行为符合相关法律法规的规定。

3. 明确法律责任:通过法律法规或合同等方式明确智能客服的法律责任和义务。这样可以为解决争议和纠纷提供法律依据。

五、总结

总的来说,智能客服的情绪安抚策略虽然可以提高服务质量和用户体验,但同时也需要警惕可能引发的法律风险。在实施这一策略时,我们不仅需要提高技术水平、确保数据的隐私和安全、还需重视和法律法规的结合。

这样既能满足市场需求和提高服务体验,同时也能尽量避免潜在的法雷问题和纠纷。通过持续的改进和优化,我们相信智能客服的情绪安抚策略将在未来得到更广泛的应用和发展。

查看未读消息

查看未读消息 查看最新消息

查看最新消息

分享

分享

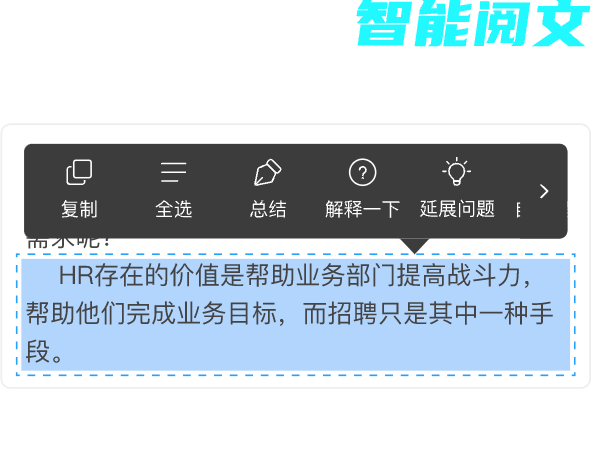

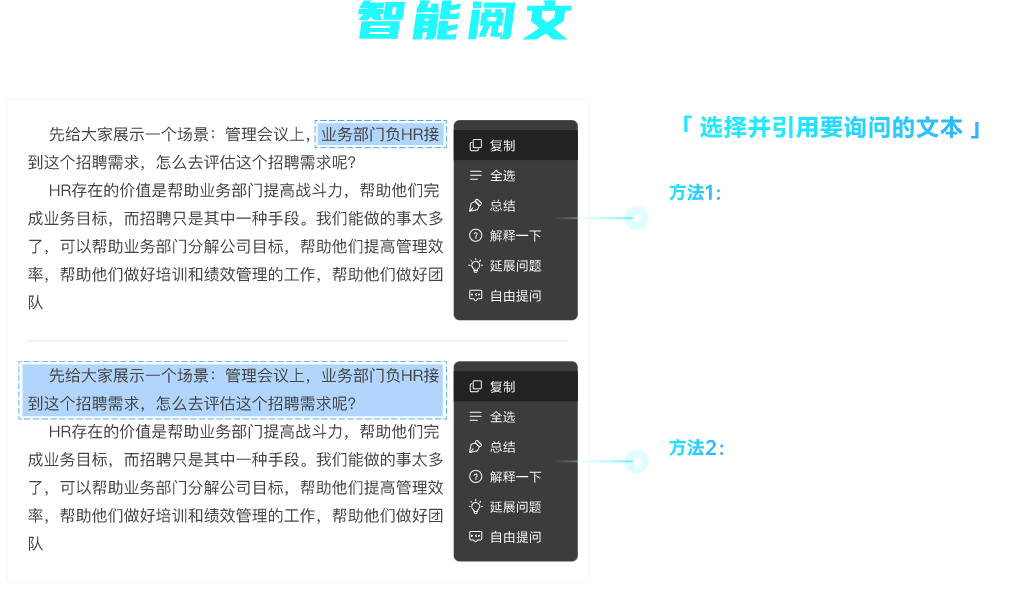

复制

复制 全选

全选 总结

总结 解释一下

解释一下 延展问题

延展问题 自由提问

自由提问

复制

复制 分享

分享